1. 통계학에서 말하는 확률이란?

다음과 같은 3가지 공리(axiom)를 만족하는 것을 공리적 확률(probability)이라고 한다.

확률이 가져야한다고 생각하는 가장 기본적인 3가지 성질로 증명없이 받아들인다.

1) 임의의 사건 $A \subset \Omega$에 대하여 $P(A) \geq 0$

2) 가능한 전체 경우의 수를 포함하는 집합 $\Omega$에 대하여 $P(\Omega)=1$

3) 배반사건열 $A _{1},A _{2},A _{3},...$에 대하여 $P( \bigcup A _{i} )= \sum _{i=1} ^{\infty } P(A _{i} )$

쉽게 말해 결국 확률은 사건 $A$를 $0 \leq P(A) \leq 1$을 만족시키는 실수집합으로 대응시키는 함수이다.

2.확률밀도함수와 확률질량함수 어떻게 다른가?

결론부터 말하자면 확률질량함수는 그 자체로 확률을 의미하고 확률밀도함수는 확률을 의미하지 않는다.

이산형확률변수 $X$는 $X=x _{1},x _{2},...$등으로 이산적인 값(discrete value)을 가질 수 있는 random 변수이다.

$X$의 확률질량함수는 $f(x)=P(X=x)$이고 $\left \{ X=x \right \}$라는 사건이 일어날 확률을 의미한다

그래서 기본적인 질량함수의 정의에도 $0 \leq f(x) \leq 1$을 만족시키는 함수 $f(x)$라고 쓰기도 한다.

그리고 모든 경우의 수를 모은 표본공간에서도 $\sum _{x=1} ^{n} f(x)=1$이라고 한다.

분명히 확률질량함수는 확률의 공리를 만족하는 '확률'이다.

확률밀도함수는 어떨까?

사실 많은 사람들이 헷갈려하지만 연속형확률변수 $Y$의 확률밀도함수 $g(y)$는 기본적으로 $$g(y)>1$$이 가능하다는 것이 중요하다.

확률의 공리를 위반하고 있다는 것으로 확률밀도함수는 확률이 아니다.

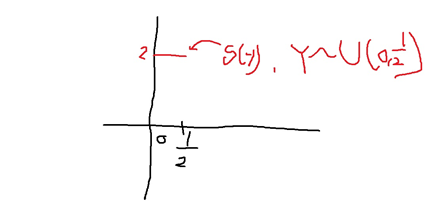

위 그림은 연속형 균일분포 $U(0,\frac{1}{2})$의 확률밀도함수 $g(y)=2$를 나타내고 있다.

분명히 모든 $0<y<\frac{1}{2}$에 대하여 $g(y)=2$로 1보다 크다. 그러면 $Y=0.12$가 일어날 확률은 2인가?

3.확률밀도함수는 어떻게 정의하는가?

연속형확률변수 $Y$의 확률밀도함수 $g(y)$는 다음과 같이 정의되는 함수이다.

$$\lim _{\triangle y -> 0} {\frac{1}{\triangle y} P((y,y+ \triangle y))= \lim _{\triangle y -> 0} {\frac{1}{\triangle y} \int _{y} ^{y+ \triangle y} {g(z)dz=g(y)}}}$$

근사적으로 $\triangle y$가 0에 충분히 가까우면 $Y=y$가 $(y,y+ \triangle y)$라는 구간에 속할 확률은

$$P((y,y+ \triangle y)) \approx g(y) \triangle y$$으로 구해진다

여기서 주목할 부분은 구간에 속할 확률이 한 점에서의 확률밀도 $g(y)$와 구간의 길이 $\triangle y$의 곱으로 구해진다.

위 식에서 구간 $\triangle y = 0$이면 연속형확률변수 $Y$가 하나의 점 $y$일 확률이 $P(Y=y)=0$

길이가 200인 선분을 0~200의 x축에 놓고 $Y=10$이라는 하나의 점을 뽑는다고 하면 그럴 확률은 얼마인가??

직관적으로 당연히 0이다. 왜냐하면 0~200까지의 길이가 200인 선분위에 점은 무수히 많아서 가능한 모든 경우의 수인 분모가 $\infty$여서 확률은 $\frac{1}{\infty}=0$이 된다.

이런 이유로 모든 연속형확률변수는 하나의 점 값을 가질 확률은 0이다.

그런의미로 구간에 속할 확률을 정의하지, 하나의 점을 가질 확률을 논하지는 않는다

4. 가능도함수는 무엇인가?

가능도함수는 그 정의 상 확률변수의 확률분포를 나타내주는 함수인 확률밀도함수(혹은 확률질량함수)와 동일한 함수인데 그냥 관점의 차이이다.

------------------------------------------------------------------------------------------------------------------------

데이터 $X$의 확률분포가 고정된 모수 $\theta$를 가질 때 이러한 분포에서

원하는 데이터 $X=x$을 추출할 확률(확률밀도함수는 확률이 아니지만 일단 이해하기 쉽게 의미상)을 나타내주는 것이 확률함수 $f(X=x|\theta)$이다.

확률함수는 주어진 고정된 모수 $\theta$를 가지는 확률분포에서 어떤 데이터 $X=x$을 뽑아낼 확률값들의 함수이다.

-------------------------------------------------------------------------------------------------------------------------------

가능도함수는 $L( \theta |X=x)=f(X=x| \theta )$으로 정의하는데 반대로 데이터 $X=x$이 고정되어있다.

연구자가 관심있는 고정된 $X=x$을 뽑아낼 확률 분포의 모수 $\theta$의 가능도를 측정하고 싶을 때 사용하는 것이다.

모수 $\theta$에 따라서 확률분포는 달라질 것이고 (전체적인 큰 틀은 동일하겠지만) 고정된 $X=x$을 뽑아내는 가능성이 달라질 것이다. 이 값들의 함수가 가능도함수이다.

5. 가능도는 확률인가? 아닌가?

확률의 공리중 2번째를 위반하여 확률이 아니다.

모든 가능한 $\theta$에 대한 가능도함수의 적분 $$\int _{\theta } ^{} {L( \theta |X)d \theta } \neq 1$$

왜 1이 아니냐고 물을 수 있는데 $L( \theta |X=x)=f(X=x| \theta )$이고 x로 적분해야 1이기 때문이다.

$$ \int _{X} ^{} {L( \theta |X)dX= \int _{X} ^{} {f(X| \theta )dX=} } 1$$

일반적으로 우리들은 확률이 단순히 가능성이라고 생각해서 가능도도 확률이라고 오해하기 쉽다

5. 가능도는 왜 사용하는가?

마지막으로 가능도(likelihood)를 사용하여 생기는 이점에 대해 생각해보자.

분명히 연속형 확률변수의 확률밀도함수는 어떤 값을 가진다.

(-3,3)이라는 구간에서 점 Y=1, Y=2, Y=3을 뽑는다고 해보자 그럴 확률은 얼마인가?

앞에서 계속 이야기했지만 모두 0 이다.

그러나 나올 가능성은 분명히 조금씩 다르다는 것이다.. 위의 그림에서 1이 나올 가능성이 더 높다고 보는 것이 맞다.

가능도함수 $L( \theta |X=x)=f(X=x| \theta )$이고 가능도와 확률밀도값이 같다.

그러나 가능도를 사용하면 Y=1, Y=2, Y=3중 어떤 값이 더 나올 가능성이 높은지 판단할 수 있다.

요약하자면 가능도는 연속형 확률변수에서 하나의 점을 뽑을 가능성을 비교할 수 있게 도와주는 수단이 된다.

확률질량함수에서는 당연히 하나의 점에서 확률을 의미하니 이런 이점이 큰 의미는 없다

사람들이 이야기하기에 확률이 가능성을 의미하니까 무의식적으로 헷갈리게 되는데

이런 차이가 있다는 것을 생각해보면 좋을 것 같다

--------------------------------------------------------------------------------------------------------------------------------------------------

요약?

확률변수의 확률함수(probability function)는 고정된 모수 $\theta$를 가지는 확률분포에서 데이터 세트 X를 추출할 확률이다.(확률밀도함수면 확률밀도겠지만)

가능도함수는 확률함수와 똑같은 값을 갖지만 관점을 바꿔서 생각한 것이다.

원하는 고정된 데이터 세트 X를 추출할 확률을 모수 $\theta$의 변화에 따라 구해준 함수라고 처음에 생각했지만 확률이 아니고 가능도이다.

가능도가 확률이 아닌 근본적인 이유는 가능도함수를 모수 $\theta$로 적분하면 1이 아니기 때문이다.

likelihood인 가능도는 직관적으로 확률밀도 값이다.

이렇게 생각하는 것이 자연스러운 것은 가능도함수와 확률밀도함수는 관점만 다를 뿐 같은 함수니까

확률밀도는 확률값이 아니다. 연속확률변수에서 하나의 값을 가질 확률은 무조건 0이다.

그러나 가능도(확률밀도 값)를 사용하여 하나의 값을 가질 가능성을 비교하게 해준다.

'다시보는 통계학' 카테고리의 다른 글

| 분포함수에 관한 중요한 정리(theorem) (0) | 2021.12.07 |

|---|---|

| 누적확률분포함수(cumulative probability distribution)에 대하여 (0) | 2021.12.06 |

| p-value에 대한 오해 (0) | 2021.10.06 |

| 머신러닝 모델에서의 bias와 variance에 대하여 (0) | 2021.10.06 |

| 결정계수에 대한 오해 (0) | 2021.10.04 |