1. CornerNet

1-1) 구조

bounding box가 top-left corner 좌표와 bottom right corner 좌표만 있으면 충분하다는 점을 이용

backbone network에서 feature map을 뽑아 top left point만을 예측하는 heatmap과

bottom right point를 예측하는 heatmap을 생성함

그 heatmap을 embedding하여 각 point가 어떤 정보를 가지는지 확률분포를 계산

top left embedding과 bottom right embedding이 같은 bounding box에서 나온 것(같은 object에서 나온 것)이라면 비슷한 분포로 나올 것

당연하지만 object가 여러개 있을 수 있으니(그림에서는 2개) point도 여러개 예측

위<top left> 아래<bottom right>로 쌍으로 pair하여 embedding하여 분포가 비슷한지 확인

single stage 구조로 성능보다는 속도를 강조했다

2. CenterNet

2-1) 첫번째 방법

bounding box는 top left point와 bottom right point뿐만 아니라 center point도 detection 성능에 중요한 역할을 한다

3개의 point를 동시에 추정하는 방식으로 CornerNet같이 학습한다

2-2) 두번째 방법

center point가 성능에 중요한 영향을 미치더라도 top left point와 bottom right point만 있으면 bounding box를 결정시키는데 굳이 이들을 모두 추정해야하나?

center point가 중요하다는 것을 알았으니까 center point와 너비(width), 높이(height)를 이용하여 bounding box를 특정하겠다

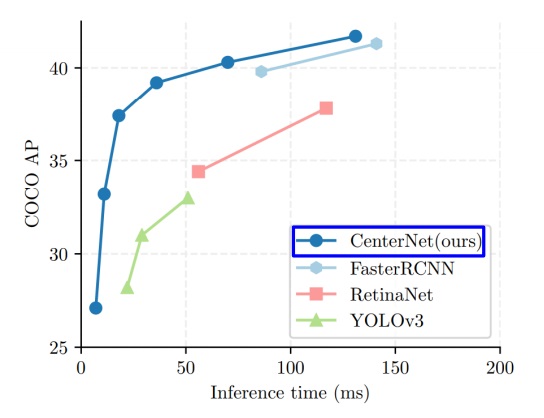

이렇게 detection한 것이 다른 모형에 비해 성능이 제일 좋았다고 말하고 있다

그래서 보통 bounding box를 구할때는

top-left & bottom right point를 구하느냐?

center, width, height를 구하느냐?로 나뉨

'딥러닝 > Computer Vision' 카테고리의 다른 글

| image to image translation - super resolution, colorization, style transfer - 의 개념 이해하기 (0) | 2023.06.29 |

|---|---|

| conditional generative model과 Generative Adversarial Network 기본 개념 이해하기 (0) | 2023.06.28 |

| 3d 모델을 추정하는 Denspose와 다양한 task를 한번에 풀어내는 RetinaFace (0) | 2023.06.26 |

| image의 landmark를 추정하는 모델의 기본인 Hourglass Network (0) | 2023.06.25 |

| landmark localization task 기본개념 배우기 (0) | 2023.06.25 |