보통 범주형 변수만 사용가능한 것처럼 decision tree를 설명하지만

decision tree의 구분 feature로 연속형 변수도 사용가능합니다.

방법은 여러 가지가 있는데 하나를 예로 들어 설명하자면

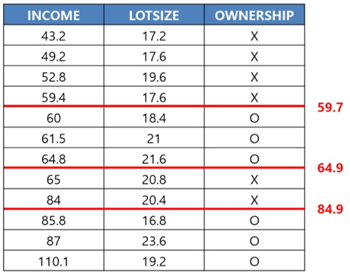

예시 데이터가 위와 같다고 합시다.

구분하고자하는 feature 여기서는 예를 들어 income을 정렬합니다.

그러면 label이 바뀌는 지점이 생기는데

label이 바뀌는 지점의 평균점을 기준값으로 잡습니다.

각각 59.7, 64.9, 84.9 세 지점이 생기는데 각 지점에서 information gain이 최대가 되는 기준지점을 찾습니다.

gini 계수를 이용해 계산하면 income이 59.7보다 클때와 작을때로 구분하는 것이 최대라고 합니다.

lotsize도 똑같은 방식으로 기준값을 잡고 각 기준값에 대해 information gain이 최대가 되는 기준지점을 잡습니다.

참고

의사결정나무(Decision Tree) :: 독립변수가 연속형 일 때 (tistory.com)

의사결정나무(Decision Tree) :: 독립변수가 연속형 일 때

2020/04/21 - [통계 지식/Algorithm] - Decision Tree란? :: ID3 알고리즘, 엔트로피란? Decision Tree란? :: ID3 알고리즘, 엔트로피란? 의사결정나무란? Decision Tree란? 의사결정 규칙을 나무구조로 나타내에..

leedakyeong.tistory.com

'정형데이터' 카테고리의 다른 글

| 범주형 변수를 전처리하는 방법의 모든 것 (0) | 2022.05.26 |

|---|---|

| 회귀문제에서 사용하는 decision tree (0) | 2021.12.15 |

| decision tree의 불순도를 측정하는 기준 (0) | 2021.12.14 |

| decision tree의 가지치기(pruning) (0) | 2021.12.13 |

| 예시를 통해 이해하는 decision tree가 생성되는 원리 (0) | 2021.12.11 |